AMD vs Nvidia auf der CES 2026: Zwei unterschiedliche KI-Chip-Strategien

AMD und Nvidia nutzten die CES 2026, um das Schlachtfeld der KI-Chips neu zu definieren. Während AMD KI überall vorantreibt – von PCs bis hin zu Embedded Edge –, setzt Nvidia verstärkt auf Full-Stack-KI-Supercomputer für Hyperscaler.

Nvidia (NVDA) handelt nahe dem oberen Ende seiner 52‑Wochen-Spanne im hohen $180er- bis niedrigen $190er-Bereich, nach einem starken Jahr 2025, das durch die Nachfrage nach Data-Centre-GPUs und Hyperscaler-KI-Investitionen angetrieben wurde. AMD (AMD) verzeichnete rund 70 % Gewinn im Jahresvergleich, wird aber trotz zunehmender Wahrnehmung als „KI-Beta mit Aufholpotenzial“ weiterhin mit einem Abschlag gegenüber NVDA beim Kurs-Umsatz-Verhältnis gehandelt.

AMD: „KI überall“ – vom PC bis zum Accelerator

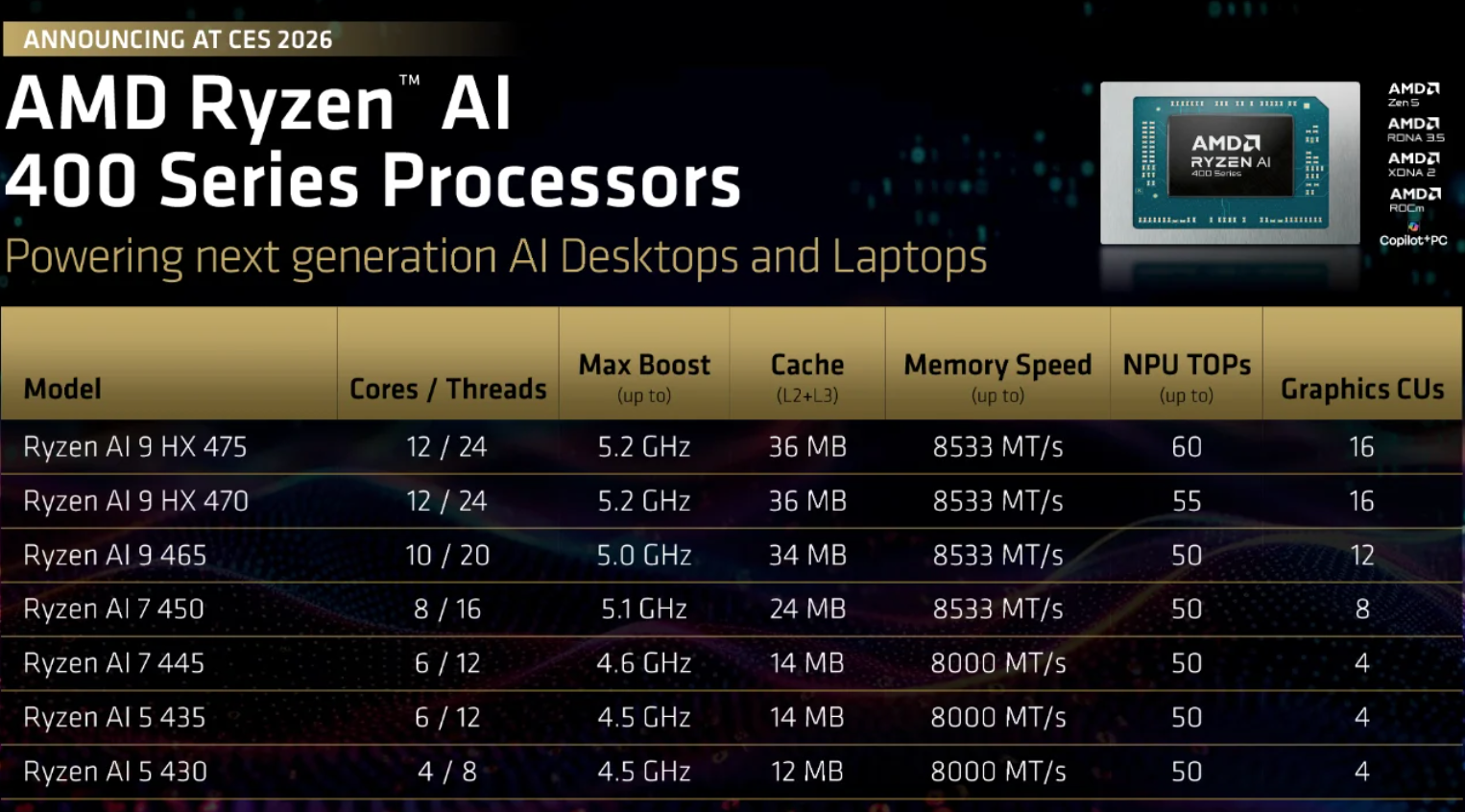

Auf der CES erweiterte AMD sein Ryzen AI-Portfolio um neue Ryzen AI 400 / AI Max+ Laptop-Chips sowie eine neue Ryzen AI Embedded-Reihe auf Basis von Zen 5, die auf Automobil-, Industrie- und „physische KI“-Anwendungen abzielt. Das Management positioniert die installierte PC-Basis explizit als verteilten KI-Edge, wobei OEM-Designs im Laufe des Jahres 2026 hochgefahren werden sollen.

Im Data-Centre-Bereich erweitert AMD seine MI300/MI455 Accelerator-Roadmap und positioniert diese GPUs als kostengünstigere, offenere Alternativen zu Nvidia für Training und Inferenz im großen Maßstab, wobei OpenAI-ähnliche Kunden als realistische Anwender hervorgehoben werden. Für Trading-Desks erscheint AMD als klassische „Share-Gain-Story“: kleinere installierte Basis, aber erhebliches operatives Hebelpotenzial, falls ROCm-, MI-Serien-Erfolge und Ryzen AI-Integrationsraten realisiert werden.

Nvidia: setzt alles auf KI-Supercomputer

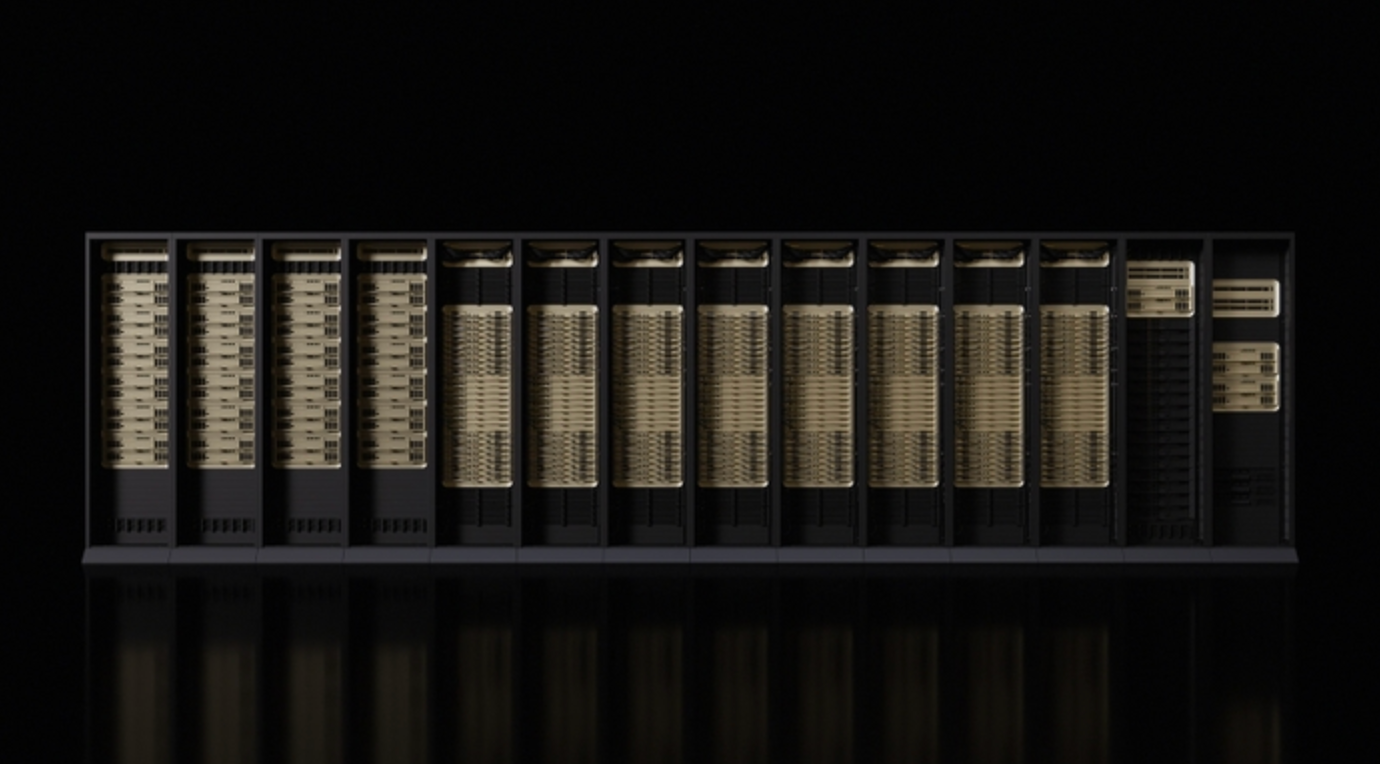

Nvidia antwortete mit der Rubin-Plattform – sechs neue Chips, darunter Rubin-GPUs, Vera-CPUs und aktualisierte NVLink 6 / Spectrum‑X Netzwerke, die als schlüsselfertiger KI-Supercomputer-Stack angeboten werden.

Rubin richtet sich explizit an „KI-Fabriken“ für fortschrittliche Modelle und agentische Workloads, wobei die ersten Systeme in der zweiten Jahreshälfte 2026 erwartet werden.

Entscheidend ist, dass Rubin mit allen vier großen Hyperscalern (AWS, Azure, Google Cloud, Oracle Cloud) und spezialisierten GPU-Clouds eingeführt wird, was Nvidias Rolle im Zentrum der KI-Infrastruktur-Ausgaben weiter festigt. Aus Trading-Sicht bleibt NVDA der De-facto-KI-Index: hoch bewertet, aber gestützt durch mehrjährige Cloud-Investitionen; jede sichtbare Verschiebung hin zu kundenspezifischen ASICs oder langsameren KI-Budgets ist das Hauptrisiko für das aktuelle Multiple.

Warum das wichtig ist

Die CES 2026 unterstrich, dass der KI-Handel in eine anspruchsvollere Phase eintritt. Die einfache Erzählung – „KI gleich GPUs gleich Aufwärtspotenzial“ – verliert an Bedeutung. Entscheidend ist nun, wo KI-Workloads tatsächlich landen, wie nachhaltig die Investitionen sind und welche Anbieter ihre Preismacht behalten, wenn Inferenz, Effizienz und Implementierung in den Mittelpunkt rücken.

Nvidias Strategie festigt seine Position im Kern der Hyperscaler-KI-Budgets, aber diese Konzentration birgt auch Risiken. Mit zunehmender Reife des Trainings und wachsender Inferenz-Skalierung dürften die Margen unter Druck geraten und der Wettbewerb – von AMD, kundenspezifischem Silizium und Cloud-nativen Alternativen – sich verschärfen. Das Ausführungsrisiko steigt, während die Bewertungen hoch bleiben.

AMD hingegen setzt auf Breite statt Dominanz. Der Ansatz „KI überall“ positioniert das Unternehmen so, dass es profitiert, wenn sich die KI-Adoption über Mega-Data-Center hinaus auf PCs, Industriesysteme und Embedded-Anwendungen ausweitet. Für die Märkte bedeutet das: Bei AMD geht es weniger um absolute Führerschaft, sondern mehr um schrittweise Marktanteilsgewinne auf einer wachsenden KI-Fläche.

Kurz gesagt, die CES bestätigte, dass KI nicht mehr nur eine Einbahnstraße ist. Die nächste Phase wird von den Implementierungskosten und nicht nur vom Rechenambitionen geprägt sein.

Strategische Implikationen für den KI-Chip-Handel

Die CES 2026 bestätigt, dass kein Anbieter mehr reine Chips verkauft; beide liefern Plattformen – Silizium plus Interconnect plus Software-Ökosysteme (CUDA vs. ROCm) und Referenzsysteme.

Für Investoren stellen sich nun die Kernfragen: Wer gewinnt zusätzliche Hyperscaler-Workloads, wie viel Preismacht bleibt bestehen, wenn AMD, kundenspezifisches Silizium und regulatorischer Druck zunehmen, und wie nachhaltig sind die KI-Investitionen im nächsten makroökonomischen Abschwung.

In diesem Rahmen bleibt Nvidia die High-Conviction-Kernposition für KI-Infrastruktur, während AMD bei erfolgreicher Umsetzung seiner „KI überall“-Strategie in den nächsten 12–24 Monaten ein höheres Beta und damit größeres Aufwärtspotenzial bei Accelerators und PC/Edge-KI bietet.

Wichtigste Erkenntnis

Die CES 2026 zeigte eine klare strategische Divergenz. Laut Analysten ist Nvidia eine High-Conviction-Systemwette auf Hyperscaler-KI-Infrastruktur, allerdings mit zunehmender Sensitivität gegenüber Inferenz-Ökonomie, Preisdruck und makroökonomischen Bedingungen. AMD bietet durch die Integration von KI in PCs, Edge-Geräte und alternative Accelerator-Stacks ein höheres Beta – ein risikoreicherer Weg, aber mit erheblichem Hebel, falls die Adoption in den nächsten 12–24 Monaten zunimmt.

Für Investoren und Trader entwickelt sich der KI-Chip-Handel von einer Momentum-Story zu einem Selektivitäts-Trade, bei dem Plattform-Bindung, Kosteneffizienz und Workload-Mix ebenso wichtig sind wie reine Performance.

Technischer Ausblick für AMD und Nvidia

AMD stabilisiert sich nach einer volatilen Korrektur von den $260-Hochs, wobei sich der Kurs um die $223-Marke konsolidiert, während Käufer vorsichtig zurückkehren. Die übergeordnete Struktur bleibt zwar in einer Range, aber das Momentum verbessert sich: Der RSI steigt stetig über die Mittellinie und signalisiert einen allmählichen Wiederaufbau bullischer Überzeugung statt eines abrupten Risikoaufschwungs.

Aus struktureller Sicht bleibt die $187-Unterstützung ein wichtiger Abwärtsbereich; ein Bruch darunter dürfte zu verkaufsgetriebenen Liquidationen führen, während die tiefere $155-Zone eine längerfristige Trendunterstützung markiert.

Auf der Oberseite begrenzt der $260-Widerstand weiterhin die Erholung, was bedeutet, dass AMD anhaltenden Kaufdruck benötigt, um einen erneuten Aufwärtstrend zu bestätigen. Aktuell deutet das Kursverhalten auf eine Konsolidierung mit leicht bullischem Bias hin, statt auf einen klaren Ausbruch.

NVIDIA versucht sich nach der jüngsten Korrektur zu stabilisieren, wobei der Kurs den $189-Bereich zurückerobert und sich wieder in Richtung der Mitte der breiteren Range bewegt. Der Rebound von der $170-Unterstützungszone hat die kurzfristige Struktur verbessert, während das Momentum beginnt, konstruktiv zu werden: Der RSI steigt deutlich über die Mittellinie und signalisiert zunehmendes Kaufinteresse statt eines rein technischen Rebounds.

Dennoch bleibt der Aufwärtstrend durch Widerstände bei $196 und dem wichtigen $208-Level begrenzt, wo frühere Anstiege zu Gewinnmitnahmen führten. Solange NVDA über $170 bleibt, bleibt die übergeordnete Struktur intakt, aber ein nachhaltiger Ausbruch über $196 wäre nötig, um eine robustere bullische Fortsetzung zu bestätigen.

Die angegebenen Wertentwicklungen sind keine Garantie für zukünftige Ergebnisse.